Convertir a cualquiera en una estrella porno usando la tecnología deepfake.

Con este slogan se publicita un servicio online que ofrece, precisamente, esto: colocar la cara de alguien en un vídeo de sexo explícito.

Y ojo, que no hablo de simplemente pegar, como si de un emoticono se tratase, nuestra cara encima de la de la actriz o actor en cuestión, sino aplicar sistemas de machine learning para que, en base a la foto o fotos que le subamos a la plataforma, digitalizar ese rostro, y colocarlo en el del profesional manteniendo los mismos patrones de luz y movimiento que tenga la escena.

¿El resultado final? Pues un vídeo que, si no nos fijamos mucho, bien podría parecer real, y que en todo caso no parece una simple caricatura hecha a modo de broma.

Desde los comienzos de las ultrafalsificaciones, uno de los mercados donde claramente tenía más potencial de crecimiento, era en la industria pornográfica.

Parece que los humanos tenemos algo que nos incita a imaginarnos a ese famoso de turno en sus encuentros íntimos, y gracias a esta tecnología, es posible verlo (aunque sea un vídeo falso).

De hecho, ya hemos hablado en más de una ocasión, poniendo ejemplos reales, de ultrafalsificaciones a famosos. Su papel como herramienta propagandística también es obvia, y era cuestión de tiempo que se empezasen a usar para extorsionar, o simplemente para hacer daño a ciudadanos normales y corrientes.

La empresa Sensity AI (EN) ha publicado un estudio donde estima que entre el 90 % y el 95 % de todos los vídeos deepfake online son pornografía sin consentimiento, y que alrededor del 90 % de esos vídeos están protagonizados por mujeres.

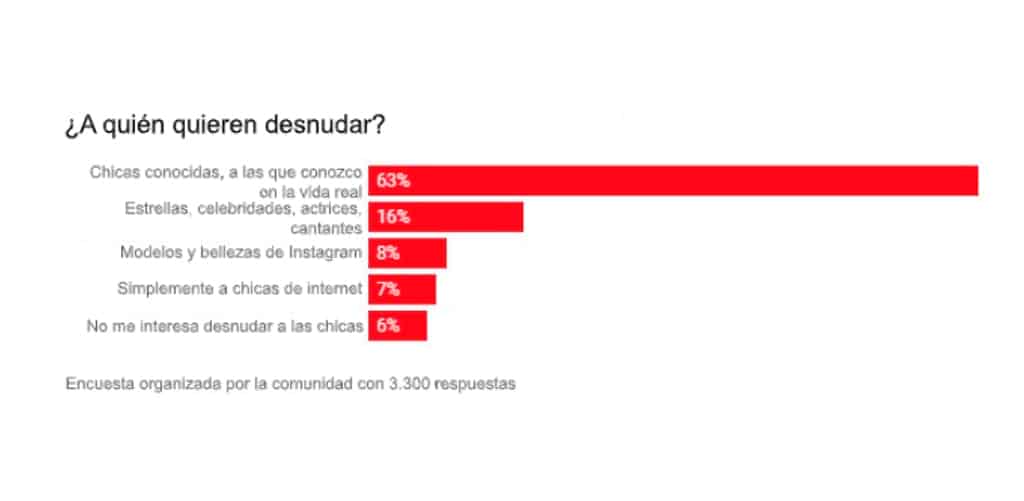

En junio de 2019, Vice descubrió (EN) la existencia de una aplicación que usaba inteligencia artificial (IA) para «desnudar» mujeres. Por poco más que 40 euros, DeepNude permitía a sus usuarios subir una foto de una mujer vestida y recibir una foto de ella aparentemente desnuda. En realidad, el software utilizaba redes generativas antagónicas, el algoritmo de los deepfakes, para cambiar la ropa de las mujeres por cuerpos desnudos muy realistas. Cuanto más escasamente vestida aparecía la víctima, mejor. Y lo que es peor, no funcionaba en hombres.

El año pasado, Sensity AI descubrió que un bot disponible públicamente estaba utilizando una tecnología muy similar en la aplicación de mensajería Telegram.

Básicamente, cualquiera podía subir a ese bot una foto de una mujer vía Telegram, y el bot devolvía una versión desnuda en apenas unos minutos. Todo de forma totalmente gratuita, o pagando 1,5 dólares si además queremos quitar la marca de la agua y saltarnos la cola de procesamiento.

Según el informe, para julio de 2020 el bot ya se había utilizado con al menos 100.000 mujeres. Sobra decir que la amplia mayoría sin consentimiento (y conocimiento) explícito por parte de ellas, y entre las que también había menores de edad.

No solo eso, sino que además el sistema contaba con varios canales diferentes en los que exponía públicamente las fotos que el bot iba generando, pudiendo valorarlas (darle me gusta). Las fotos mejor valoradas, hacían que sus emisores recibieran tokens para acceder a las funciones premium antes comentadas, cerrando el hilo (a más fotos subas, mejor valoración tendrás, y por tanto más «dinero virtual» tendrás para gastar en crear mejores fotos).

El revenge porn asistido por deepfakes

Si ya de por sí el llamado «pornovenganza» o «Revenge Porn» es uno de los principales problemas a los que se enfrentan mayoritariamente las mujeres en la sociedad actual (un estudio (ES) de la Asociación Estadounidense de Psicología en 2019 encontró que una de cada 12 mujeres acaba siendo víctima del porno vengativo en algún momento de su vida), imagínate si además el contenido en sí ni tan siquiera tiene que ser real, y que gracias a estas tecnologías, se hace creíble si no sabemos cómo identificarlos.

Conforme más y más apps de este tipo democratizan el uso de deepfakes (ya no es necesario tener conocimientos técnicos, y para colmo, con la nube, tampoco ordenadores con un procesamiento superior), aplicaciones como esta mencionada al principio del artículo suponen un riesgo social de efectos terribles para las víctimas de revenge porn.

Ya vimos recientemente cómo un par de ex-actrices de la industria pornográfica recurrieron recientemente a nuestros servicios en CyberBrainers para eliminar una huella digital dañina.

Pues imagínate que ni tan siquiera seas tú quien aparece en el vídeo, aunque a ojos de cualquiera parezca lo contrario.

El que, de pronto, cualquiera pueda con tan solo subir una o varias fotos de tu rostro a un servicio específicamente diseñado para ponerla de forma realista en vídeos pornográficos (casi todos de mujeres, y un pequeño porcentaje de hombres, siendo casi todos de porno gay), abre la veda a que todos aquellos que quieran hacer daño a sus víctimas, tengan las herramientas para hacerlo al alcance de su mano.

Por el simple motivo de que el coste psicológico de estas víctimas es semejante al de cualquier otra víctima de una crisis reputacional relacionada con contenido sexual explícito.

Es por ello que falta que judicialmente se igualen las penas. A fin de cuentas, el revenge porn asistido por deepfakes no deja de ser una violación más de nuestra identidad a ojos de terceros.

En CyberBrainers ayudamos a empresas y usuarios a prevenir, monitorizar y minimizar los daños de un ataque informático o una crisis reputacional. Si estás en esta situación, o si quieres evitar estarlo el día de mañana, escríbenos y te preparamos una serie de acciones para remediarlo.

Monitorización y escucha activa

Ponemos nuestras máquinas a escuchar para identificar potenciales fugas de información, campañas de fraude/extorsión y usurpación de identidad que estén en activo, y/o datos expuestos de ti o de tu organización.

Planes de autoridad y Presencia Digital

Ayudamos a organizaciones y particulares a definir la estrategia e implementar acciones digitales que mitiguen los posibles daños reputacionales que pueda sufrir en el futuro.

Gestión de crisis reputacionales

Cuando el mal ya está hecho, establecemos un calendario de acciones para reducir su duración e impacto, y que la organización y/o persona pueda volver a la normalidad lo antes posible.

Pablo F. Iglesias es el fundador de CyberBrainers, consultora especializada en blindaje reputacional, construcción de autoridad digital y asesoramiento a víctimas de fraude online, de EliminamosContenido, el servicio de desindexación y eliminación de contenido dañino en Internet, y del sello editorial Ediciones PY.

Speaker internacional, Experto en ayudar a referentes digitales, influencers y marcas personales a diversificar su presencia y construir reputaciones inquebrantables. Especialista en transformar la presencia online de referentes a través de estrategias de diversificación digital, posicionamiento SEO, apariciones en medios y blindaje preventivo ante crisis reputacionales.

Reconocido divulgador en Seguridad TIC, ganador de varios premios ESET, Bitácoras y Red Seguridad a la divulgación en Ciberseguridad, colaborador habitual en varios programas de televisión, radio y periódicos, y representante del emprendimiento español en Silicon Valley.

Autor de seis libros y host del videopodcast enCLAVE DIGITAL.

Actualmente asesora a grandes patrimonios y a víctimas de fraudes online, demostrando con hechos su filosofía de diversificación y gestión de riesgo.