Hubo un tiempo que un contenido en vídeo o en audio sentaba cátedra.

Las barreras de entrada a la hora de manipular una imagen es cierto que han bajado históricamente lo suficiente como para no poder fiarse de una fotografía, pero no es hasta hace realmente poco (unos pocos años) que ha ocurrido lo mismo con el vídeo y el audio.

Ahora mismo, y como expliqué ya en varias charlas a lo largo de estos últimos años, es posible con algo tan sencillo como una aplicación móvil crear vídeos o audios de personas que podrían parecer reales, cuando realmente no lo son.

Que es fácilmente manipulable, creando a ojos de un tercero una prueba para desacreditar a esa persona.

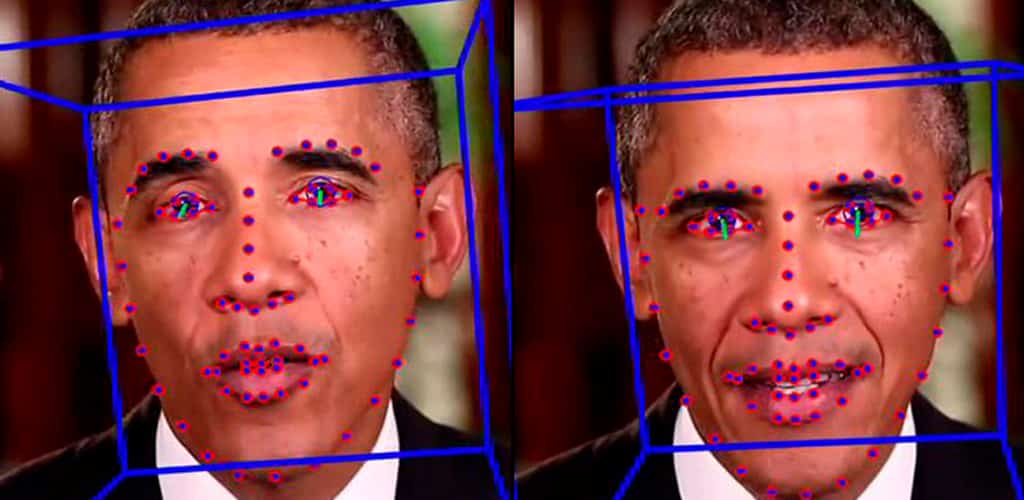

Hablamos, por tanto, del contenido sintético, de ultrafalsificaciones, o como se le conoce más habitualmente, de los deepfakes.

Algunos que no esperan más que hacernos reír, como fue el caso de aquel Deep Fake con el que alguien ha puesto la cara de Steve Buscemi en el cuerpo de Jenifer Lawrence, pero cada vez más utilizados en sexting (hacer parecer que otra persona tiene un vídeo de contenido adulto grabado) y por supuesto timos y extorsiones de diversa índole (hacerle pensar a una pareja que su otra mitad le ha engañado con pruebas gráficas, o poner en tela de juicio a una persona famosa con unas declaraciones creadas artificialmente,…).

En una notificación (EN) de la División Cibernética del Federal Bureau of Investigation (FBI), se alerta de que en el próximo año y medio crecerá sobremanera el uso fraudulento de este contenido sintético.

Gracias al uso de herramientas de machine learning, se realizan cada vez más «ciberataques malintencionados para promover el comercio y aumentar el impacto de sus actividades”.

Un ejemplo muy común últimamente es la proliferación de supuestos medios de comunicación y periodistas falsos que generan noticias (no las cubren), bien sea con fines propagandísticos, o simplemente con idea de monetizar sus portales a cualquier coste.

¿Qué podeos hacer para defendernos de los deepfakes?

A la vista de todo esto, queríamos compartir contigo una serie de recomendaciones para defendernos de los deepfakes.

A saber:

- Fijarse en los detalles más complicados de emular en un vídeo o imagen: Hablo, principalmente, de la distancia entre los ojos de una cara o la colocación de las orejas. El ser humano curiosamente es muy bueno a la hora de analizar proporciones en rostros (estamos biológicamente diseñados para ello), y si algo falla puede que sea nuestro cerebro avisándonos de que quizás estamos ante una ultrafalsificación.

- Fijarse en los movimientos y el lenguaje corporal: Por ejemplo, algo como el pestañeo de los ojos no siempre los deepfakes son capaces de emularlo correctamente. Además, se les suele ver más el plumero cuando hay ligeros movimientos de cabeza o torso, o a la hora de sincronizar dichos movimientos con los esperables que hacemos mientras hablamos.

- Contrastar información en diferentes fuentes: Por supuesto, no es recomendable informarse únicamente por una misma fuente de información. Ya no solo porque esta podría estar intentando engañarnos, sino porque lo mismo sus periodistas son las víctimas de uno de estos engaños, pensando que es real ese deepfake y haciéndose por tanto eco de ello.

- Las redes sociales no son una herramienta de información, sino de entretenimiento: Hay que tener clara esta diferencia. El objetivo de una red social es que pases el mayor tiempo posible usándola, no informarte correctamente. De ahí que muchos deepfakes se comparten por ahí (menos controles, mayor capacidad de viralización).

- Cuidado con exponer mucha información y contenido gráfico nuestro: De cara a ser víctima de los deepfakes, mientras menos contenido audiovisual haya de nosotros públicamente, mejor. A fin de cuentas, estas herramientas funcionan mejor conforme mayor es la biblioteca de recursos gráficos que tenemos de la víctima. De ahí que muchas de estas ultrafalsificaciones utilicen rostros de personas famosas, de las que ya tenemos mucho contenido gráfico en la red. Y como en cualquier otro fraude, mientras menos información haya de nosotros, menos herramientas tendrá el ciberdelincuente para generar deepfakes que resulten creíbles.

En CyberBrainers ayudamos a empresas y usuarios a prevenir, monitorizar y minimizar los daños de un ataque informático o una crisis reputacional. Si estás en esta situación, o si quieres evitar estarlo el día de mañana, escríbenos y te preparamos una serie de acciones para remediarlo.

Monitorización y escucha activa

Ponemos nuestras máquinas a escuchar para identificar potenciales fugas de información, campañas de fraude/extorsión y usurpación de identidad que estén en activo, y/o datos expuestos de ti o de tu organización.

Planes de autoridad y Presencia Digital

Ayudamos a organizaciones y particulares a definir la estrategia e implementar acciones digitales que mitiguen los posibles daños reputacionales que pueda sufrir en el futuro.

Gestión de crisis reputacionales

Cuando el mal ya está hecho, establecemos un calendario de acciones para reducir su duración e impacto, y que la organización y/o persona pueda volver a la normalidad lo antes posible.

Pablo F. Iglesias es el fundador de CyberBrainers, consultora especializada en blindaje reputacional, construcción de autoridad digital y asesoramiento a víctimas de fraude online, de EliminamosContenido, el servicio de desindexación y eliminación de contenido dañino en Internet, y del sello editorial Ediciones PY.

Speaker internacional, Experto en ayudar a referentes digitales, influencers y marcas personales a diversificar su presencia y construir reputaciones inquebrantables. Especialista en transformar la presencia online de referentes a través de estrategias de diversificación digital, posicionamiento SEO, apariciones en medios y blindaje preventivo ante crisis reputacionales.

Reconocido divulgador en Seguridad TIC, ganador de varios premios ESET, Bitácoras y Red Seguridad a la divulgación en Ciberseguridad, colaborador habitual en varios programas de televisión, radio y periódicos, y representante del emprendimiento español en Silicon Valley.

Autor de seis libros y host del videopodcast enCLAVE DIGITAL.

Actualmente asesora a grandes patrimonios y a víctimas de fraudes online, demostrando con hechos su filosofía de diversificación y gestión de riesgo.